中铁上海(投资)集团有限公司,上海 201100

摘 要:随着我国电气化铁路里程增加,接触网这一无备用系统的运行监测压力日渐突出。本文通过对接触网上部腕臂及定位装置的几何结构分析,从算法层面入手,采用YOLOv5深度学习目标检测算法,结合集通铁路工程实际,实现了对接触网腕臂及定位装置的目标检测建模,验证了模型的有效性。在此基础上,通过界面化进一步实现对视频中接触网腕臂及定位装置的目标实时检测,为软件层面实现接触网设备运行监测技术提供了参考。

关键词:接触网;深度学习;YOLOv5;目标检测

1引言

自1975年新中国第一条电气化铁路宝成线建成投运以来,我国电气化铁路运营里程持续高速增涨,2012年哈大高铁建成,我国电气化铁路总里程超过4.8万公里,跃居世界第一[1]。《中长期铁路网规划》中指出,到2025年,我国铁路里程将达到17.5万公里,其中高速铁路达到3.8万公里。铁路作为重要的基础设施,在我国国民经济的发展过程中发挥了极其重要的作用,尤其是电气化铁路因其牵引动力、能源效率等多方面的优势在我国路网全面普及。全世界最大的电气化铁路运营网络对铁路电气化设备的监测技术提出了很高的要求。

电气化铁路牵引供电系统主要由牵引变电系统和接触网系统组成,不同于牵引电力系统中存在备用的先天条件,接触网系统是铁路特有的无备用供电设施,且接触网设备需要经受各种恶劣外部环境的影响。为保障机车供电的可靠性,我国电气化铁路运维中广泛采用铁路供电安全检测监测系统(6C系统)[2],通过弓网综合监测、安装红外等传感器、上传图像人工鉴定等方式实现接触网安全巡检、运行状态检测、接触悬挂状态监测、受电弓滑板监测、供电设备地面监测等6个系统完成对接触网供电系统的监测维管工作。各系统主要通过对相关设备的状态监测[3],此类方式人工投入大,附加设备又增加了接触网系统的复杂性。

图1 铁路供电安全检测监测系统组成

由于接触网设备作业环境恶劣,在接触网设备的基础上加装各项用于监测的硬件设备,明显会增加系统复杂性,对牵引网运行带来隐患。随着近年来人工智能在图像分析处理领域的深入研究和广泛应用,国内铁路领域的研究者开始将运行监测研究方向转向挖掘图像本身信息。白瑞敏[4]采用了HOG特征与广义霍夫曼变换相结合的方法来对受电弓滑板进行识别。王科来[5]等,通过Faster RCNN算法实现了对接触网鸟巢异物识别模型的建立,并达到了较高的识别精度。

深度学习相关算法在目标检测领域已发展多年并已大规模应用于行人检测、车牌检测等诸多领域。目标检测算法按照实现方式大致可分为两阶段(two-stage)和单阶段(one-stage)两类。两阶段代表算法为Faster R-CNN[6]、Mask R-CNN[7]等,主要做法是先在图像上产生候选区域,然后在候选区域内进行目标的回归分类。两阶段算法检测精度可靠但因候选区域量大的问题,使得算法识别过程很长,不利于在要求即时性的场合应用。

在两阶段算法的基础上,Joseph Redmon等人提出YOLO[8]这一标志性的单阶段代表算法,取消候选区域,以整张图像作为输出,直接通过回归方法得到目标定位及类别标签,以此带来了远超两阶段算法的检测速度,这使得YOLO系列算法在视频检测等实时目标检测领域得到了广泛应用。

接触网上部结构集中了接触网腕臂、定位装置等大部分关键零部件,是设备运行维护过程中的重点关注部位。本文旨在通过YOLO目标检测算法建立接触网腕臂及定位装置目标检测模型,实现对图像中接触网腕臂及定位装置的自动识别及类别判断。

2接触网腕臂及定位装置

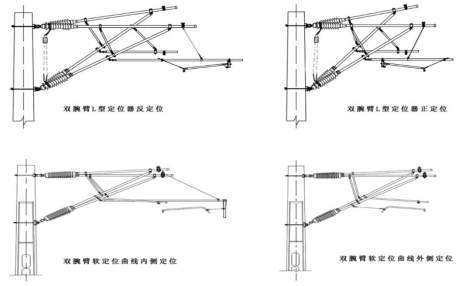

接触网支柱及其上安装的腕臂、定位装置等共同组成了接触网主要的支撑结构。根据位于接触网锚段位置的不同,锚段关节处转换支柱上一般为双腕臂结构,其他部位中间柱上为单腕臂结构。腕臂上的定位装置,普速铁路直线段目前多采用L型限位定位器;曲线段多采用软定位方式,分曲线内侧及曲线外侧两种安装方式[9]。

2.1图像特征分析

本次研究数据来自集宁至通辽铁路电气化改造工程,集通铁路为客货干线,电气化改造设计时速为160km/h,供电方式直供加回流,接触网采用简单链型悬挂方式,该线路制式也是我国当前电气化铁路接触网的主流设计方案,具有较高的普适性。区间腕臂形式以单、双腕臂为主,直线段基本采用L型限位定位器,曲线段采用软定位方式。下图为集通电化改造工程中,单腕臂及双腕臂下,直线区段L型定位器以及曲线区段(曲线半径小于800m)软定位示意图。

图2 单腕臂定位装置示意图

图3 双腕臂定位装置示意图

为便于对腕臂及定位装置几何结构进行定性分析,本次研究中暂不对双腕臂定位装置所包含的中心柱、转换柱等不同定位装配形式进行区分。

从算法层面实现对不同类型物体的目标检测,本质上是在算法训练过程中,提取图像中各类物体的特征,然后基于这些特征对待识别物体进行定位及识别。图像分析上讲,特征包括但不限于颜色、形状、几何结构、相对位置等内容。

从上图所体现的腕臂及定位装置基本类型,可看出接触网上部结构具有很强几何结构规律。从几何结构进行划分,可从腕臂形式(单、双)、定位器类型(L型定位器、软定位)、定位方向(正、反、曲内、曲外)三个维度来对一个完整的接触网上部结构进行表述,即通过“腕臂形式+定位器类型+定位器方向”就能准确对应一种特定上部结构。基于接触网上部结构极强的几何可归纳性质,我们可以将腕臂形式、定位器类型、定位器方向作为三个主要特征,通过目标检测算法实现对三大特征的提取学习,进而实现对接触网腕臂及定位装置的目标检测。

2.2特征编码分类

为便于算法实现,需对接触网上部结构的三个主要特征进行编码,现对腕臂类型、定位装置类型、定位器方向表示方式定义如下:

表1 特征表示符号

根据上述表示符号,按照“腕臂形式+定位装置类型+定位方向”的排序方式,可对8种主要的接触网上部结构用符号表示如下

表2 接触网腕臂及定位装置编号表

序号 | 腕臂及定位装置类型 | 编号 |

1 | 单腕臂L型定位器正定位 | SLZ |

2 | 单腕臂L型定位器反定位 | SLF |

3 | 双腕臂L型定位器正定位 | DLZ |

4 | 双腕臂L型定位器反定位 | DLF |

5 | 单腕臂软定位曲内安装 | SRN |

6 | 单腕臂软定位曲外安装 | SRW |

7 | 双腕臂软定位曲内安装 | DRN |

8 | 双腕臂软定位曲外安装 | DRW |

本文将基于上述接触网上部结构的三种几何特征,通过目标检测算法提取上述特征,建立接触网腕臂及定位装置目标检测模型,实现对接触网腕臂及定位装置的目标检测。

3 YOLOv5算法建模

YOLO系列算法进过迭代改进,其检测精度和速度也得到了一定的加强,本此建模采用改进后的YOLOv5目标检测算法进行建模研究。

3.1网络结构分析

YOLO算法主要有4个部分组成,如下图所示,根据算法流程,依次为输入部分(Input)、主干部分(Backbone)、颈部(Neck),预测输出部分(Prediction)。

图4 YOLOv5算法结构示意

输入部分主要负责图像输入及图像预处理工作。模型输入端采用Mosaic数据增强方法,将不同的图片翻折、调色之后进行拼接,增加数据多样性,提高训练所得网络的泛化性能。算法对初始锚框的选择进行优化,从原本手动定义优化为程序自动迭代最优。对于数据集中大小不一的照片,算法对其进行优化,自动调整为一致的大小,便于后续运算。

主干部分负责提取特征提取工作。算法主干采用了Focus模块对图像进行切片,通过局部采样减少了计算量,加快了网络速度;并采用了CSP残差结构,可以使模型得到更多的特征。

Neck部分是承上启下的一层,负责将主干部分得到的特征进行组合,增加模型的泛化性能,并将这些特征传递给预测层进行识别预测。

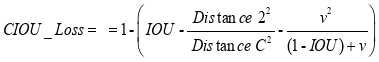

预测部分为整个网络的对外输出部分,负责根据已得到的特征对图像进行识别,根据预测的位置和类别与真实的位置类别进行损失计算,进而通过误差反向传播的方式对网络权重参数进行修正。YOLOv5算法中采用CIOU_Loss损失函数[10]进行损失计算。

(1)

(1)

(2)

(2)

式中:IOU:交并比,指预测物体框和真实物体框的交集面积与并集面积之比。v:长宽比影响因子(其中w为宽,h为高,gt为真实框,p为预测框)。C:预测框和真实框的最小外接矩阵。Distance_2:预测框的中心点和真实框的中心点的欧氏距离;Distance_C:C的对角线距离。

3.2建模及训练

结合上述YOLOv5模型结构与接触网上部结构主要几何特征,建模及验证过程如下:

Step1:数据集获取。将接触网上部结构图像数据进行人工数据标注,框选出图像中的腕臂及定位装置,并标注对应编号。将标注后的数据集划分为训练集和测试集。

Step2:将训练集数据通过算法输入端进行预处理后,由主干网络提取接触网腕臂及定位装置的图像特征,由Neck层进行特征组合,得到初始模型。

Step3:由预测部分根据现有模型对训练集图像的腕臂及定位装置位置及类型(所属编号)进行预测,将预测结果与真实框选范围和编号进行对比,通过损失函数计算误差,并将误差反向传播到主干网络,实现对主干网络中模型参数的矫正。重复上述模型训练过程,得到最终模型。

Step4:采用独立于训练集的测试集数据,使用所得模型进行图像中腕臂及定位装置的目标检测,与人工框选标注的结果进行比对,得到模型精度,评价模型有效性。

3.2.1数据集

本次原始数据,来自集通铁路电气化改造工程中机车车头处布置的摄像头录制的巡检视频,原始数据来源与实际应用场景一致。

对5个位于不同区段和时间段的巡检视频进行抽帧,每个视频的拍摄帧率为60fps,共得到27000张原始图片,因采样帧率高,每帧时间间隔极短,故存在大量相近图片,所以随机抽取27000张图片中1200张作为原始数据集。对1200组数据集,按照训练集:测试集=10:2的比例进行数据集划分。

本次实验采用labelimg对图像进行标注,根据上一章节中对接触网腕臂及定位装置类型的表示编号,对图片中出现的腕臂及定位装置进行人工框选及标注。labelimg采用归一化后占图像长宽的百分比来表示锚框的相对位置,以保证在算法训练过程中,锚框位置不随图像大小变化改变。数据标注效果如下图所示。

图5 labelimg数据标注

3.2.2目标检测评价指标

区别于基于数量的预测精度百分比,目标检测算法的评价体系以IOU(交并比,即交集除以并集,表示两个区域的重合程度)为基础建立。一般以IOU是否大于0.5来衡量预测所得锚框是否正确识别。基于IOU的定义,目标检测领域有如下几个指标对模型精度进行评价。

Precision(查准率P),表示预测结果中正确的比例。

Recall:(查全率R),表示所有待测目标中被检测出来的样本所占比例。

mAP:综合衡量查准率和查全率之后的模型精度指标,值越大表示模型精度越高。mAP@0.5为IOU为0.5时的取值,mAP@0.5:0.95是在IoU从0.5到0.95的平均,一般采用mAP@0.5和mAP@0.5:0.95对模型精度进行评价。

3.2.3模型训练

实验平台:实验平台:处理器R7-5800H,图形处理器:NVIDIA GeForce RTX 3060 GPU,运行内存:16GB。

根据本次实验所定义的8种接触网腕臂及定位装置类型编号,将YOLOv5算法初始分类数初始化为8;循环轮次设置为100。采用训练集进行模型训练,训练时间用时10h最终得到模型。模型训练过程中,误差及精度随训练轮次变化情况入下图所示。

图6 模型训练误差及精度变化

整个训练过程定位误差及分类误差稳定下降并最终收敛,各项精度指标随训练过程升高,并最终收敛,说明训练过程有效,且该模型提取到了接触网腕臂及定位装置的正确识别特征。

4模型测试及实验结果分析

4.1模型测试

100轮次训练后,取精度表现最佳的模型参数作为待测模型,采用独立于训练集以外的测试集进行预测和误差计算,验证结果如下:

表3 接触网腕臂及定位装置模型测试精度

类别 | Precision | Recall | mAP@0.5 | mAP@0.5:0.95 |

SLF | 0.996 | 1 | 0.995 | 0.747 |

SLZ | 0.894 | 1 | 0.989 | 0.732 |

DLZ | 0.96 | 0.857 | 0.978 | 0.732 |

DLF | 0.882 | 0.828 | 0.895 | 0.713 |

SRW | 0.979 | 0.969 | 0.992 | 0.742 |

SRN | 1 | 0.969 | 0.993 | 0.772 |

DRW | 1 | 0.667 | 0.866 | 0.743 |

DRN | 0.538 | 0.475 | 0.766 | 0.572 |

all | 0.906 | 0.846 | 0.934 | 0.719 |

部分测试集样本测试结果如下图所示:

图7 测试集样本测试识别结果

4.2测试结果分析

8类接触网腕臂及定位装置的精度数据中:

(1)全类型综合精度表现:mAP@0.5达到0.934,mAP@0.5:0.95达到0.719。

(2)mAP@0.5最大值:单腕臂L型定位器反定位(SLF),测试精度0.995;最小值:双腕臂软定位曲内定位(DRN),测试精度0.766。

(3)mAP@0.95最大值:单腕臂软定位曲内定位(SRN),测试精度0.772,最小值:双腕臂软定位曲内定位(DRN),测试精度0.572。

从模型整体上看,模型有着mAP@0.5=0.934、mAP@0.5:0.95=0.719的高识别准确率表现;从单个类别的预测精度上看,各类接触网腕臂及定位装置识别精度均大于0.5,且mAP@0.5集中于0.9的高水平,mAP@0.5:0.95集中于0.7的高水平。

从数据源方面分析,单腕臂在实际线路上占比大,原始数据中占比较多,模型训练所需数据量充足,所得模型效果好;双腕臂数量实际占比较少,用于训练的样本量远少于单腕臂,较大程度上影响了模型训练过程中对双腕臂类型的特征提取,但双腕臂类型模型测试精度依旧全部大于0.5且集中于0.7~0.9。

从上图所展示的部分测试实例以及实机测试来看,所得模型基本可将图片中的接触网腕臂及定位装置进行准确框选,并在锚框上方以编号形式明确所属类型。

综上所述,YOLOv5算法训练所得模型实现了对本文所研究接触网腕臂及定位装置的较高精度目标检测效果。

5界面化及视频检测应用

为便于将该研究应用到电气化铁路实际运行监测过程中,便于使用者在任何电脑平台进行应用,本文在python语言环境下,采用PYQT5库,进行了简易的图形化界面开发,并采用pyinstaller库将整个程序封装为windows系统的exe格式可执行文件,以便提高程序的泛用性,确保程序不受电脑环境限制,可进行移植使用。

整个程序简化为图像识别和视频识别两个功能,图像识别部分,用户点击上传待测图像后,程序即可对图像中接触网腕臂及定位装置进行框选,并将框内的接触网腕臂及定位装置所属类别以编号的形式进行展示。

图8 图片识别功能界面

视频识别部分,采用OpenCV2开源计算机视觉库,向用户提供摄像头实时识别和上传视频文件两种视频获取途径。上传视频后,将视频进行逐帧分析识别,动态的捕捉视频中的接触网腕臂及定位装置,并将结果实时显示在程序界面中。目前该程序在笔记本电脑上运行,每一帧的平均识别时间仅需0.08~0.1s。

图9 视频识别功能界面

6 结语

本文将接触网腕臂及定位装置几何结构特征分析与YOLOv5目标检测算法相结合,实现了对文中接触网腕臂及定位装置的目标检测建模,所得模型测试精度可靠有效,实验结果表明,YOLOv5目标检测算法对于接触网腕臂及定位装置这种几何特征明显的结构有较好的识别效果。并通过界面化和封装实现了对该模型在接触网巡检视频上的初步应用。

后续研究方面,应用范围上,可通过丰富原始数据集,提高模型精度和识别种类,将目标检测范围扩大到对接触网上部结构的故障识别。识别速度上,可通过对间隔抽取关键帧的方式,减少视频识别的计算量,在不影响识别效果的前提下,进一步提高视频识别速度。

本文进一步说明,算法层面的图像处理技术在铁路领域有着一定的应用潜力。随着相关技术的发展,越来越多的铁路设备能够通过图像处理等人工智能技术实现自动化、智能化的状态监测和故障诊断,从而提高运维效率,进一步加强铁路运行的安全可靠性。人工智能与铁路建设的领域交叉将会促进我国铁路运维技术向着智能化方向发展。

【参考文献】

[1]中国电气化铁路里程跃居世界第一[J]. 物流技术(装备版),2012(12):87-87.

[2]中国铁路总公司,中国铁道科学研究院,西南交通大学.高速铁路供电安全检测监测系统(6C系统)总体技术规范,2012.

[3]李加鑫. 基于接触网检测系统的探讨[C]. //2017年第八届中国铁路电气化技术装备交流大会论文集. 2017:593-596.

[4]白瑞敏. 基于图像处理的接触网吊弦和受电弓滑板的检测与识别[D]. 西南交通大学,2017.

[5]王科理,高福来,杨鹏,等. 基于深度学习的接触网鸟巢异物识别研究[J]. 铁道机车车辆,2022,42(2):116-121.

[6]Ren S, He K, Girshick R, et al. Faster R-CNN: Towards Real-Time Object Detection with Region Proposal Networks[J]. IEEE Transactions on Pattern Analysis and Machine Intelligence, 2017, 39(6):1137-1149.

[7]He K, Gkioxari G, Dollár P, et al. Mask R-CNN[C]//Proceedings of the IEEE International Conference on Computer Vision. 2017:2961-2969.

[8]Redmon J, pvala S, Girshick R, et al. You Only Look Once: Unified, Real-Time Object Detection[J]. 2015.

[9]罗健,莫继良,韩凌青,等. 新型高速铁路接触网腕臂与定位装置研究[J]. 铁道学报,2018,40(10):36-42.

[10] ZHENG Zhaohui, WANG Ping, LIU Wei, et al. Distance-IoU loss: Faster and better learning for bounding box regression[J]. Proceedings of the AAAI Conference on Artificial Intelligence,2020,34(7):12993-13000.

1